Imagine receber uma mensagem de áudio desesperada da sua mãe pelo WhatsApp, pedindo dinheiro rápido porque o carro quebrou em uma estrada deserta. A voz é inconfundível. A entonação, o sotaque, a respiração entre as palavras. Tudo bate perfeitamente. Você, sem pensar duas vezes, faz a transferência via PIX.

Contudo, minutos depois, você liga para ela apenas para descobrir que ela está em casa, segura, e nunca enviou áudio algum. Você não enlouqueceu: você acabou de ser vítima de um crime sintético.

O que antes parecia roteiro de ficção científica agora é uma indústria criminosa altamente lucrativa. Com o avanço assustador da inteligência artificial generativa, os golpistas deixaram de roubar apenas senhas; agora eles roubam identidades inteiras.

Para entender como essa tecnologia opera nas sombras da internet e quais são as saídas legais para se proteger, conversamos novamente com o advogado especialista em direito digital, Marcos André. A seguir, detalhamos o que você precisa saber sobre o sequestro virtual da sua voz e da sua imagem.

Leia também | Obsolescência programada e as coisas feitas para não durar

5 Perguntas essenciais sobre clonagem e deepfakes

1. O que são exatamente crimes sintéticos?

São fraudes, extorsões ou golpes praticados com o uso de inteligência artificial para criar conteúdos falsos, porém hiper-realistas. Segundo Marcos André, em vez de usar um pretexto escrito para te enganar, o criminoso sintetiza áudios e vídeos (deepfakes) que simulam perfeitamente a existência ou a ação de uma pessoa real.

2. Como os golpistas conseguem clonar a minha voz?

Eles precisam de assustadores três a cinco segundos de áudio original seu. Softwares de IA disponíveis online capturam as nuances do seu timbre e criam um modelo capaz de “ler” qualquer texto digitado pelo criminoso usando a sua voz exata. Após isso, o material de base é facilmente extraído de vídeos abertos no TikTok, Instagram ou até mesmo quando você atende uma ligação desconhecida e diz apenas: “Alô, quem está falando?”.

3. O que é um deepfake de imagem e vídeo?

É a técnica de sobrepor o rosto de uma pessoa no corpo de outra em um vídeo, ou animar uma foto estática para que ela pareça falar e piscar. Além de fraudes financeiras (como burlar a biometria facial de bancos), o deepfake tem sido usado cruelmente para criar falsos vídeos íntimos (pornografia não consensual), destruindo reputações em poucas horas.

4. Quem corre mais risco de sofrer esse golpe?

Embora figuras públicas sejam alvos fáceis por terem muito material na internet, qualquer pessoa com redes sociais abertas é uma vítima em potencial. Os criminosos muitas vezes miram em pessoas comuns porque as famílias tendem a questionar menos um pedido de socorro financeiro vindo de um parente próximo.

5. Os bancos e a polícia não barram isso?

As instituições estão em uma verdadeira corrida armamentista contra a IA. Segundo diretrizes de segurança da Febraban (Federação Brasileira de Bancos), os bancos atualizam constantemente seus sistemas de biometria (exigindo que o cliente sorria ou vire o rosto na câmera), mas os criminosos também aprimoram seus softwares. A prevenção, hoje, é muito mais comportamental do que tecnológica.

A visão jurídica: como se defender do que não é real

O grande desafio da Justiça atual é que a tecnologia avança a passos largos, enquanto as leis costumam andar de carruagem. O advogado Marcos André alerta que o vácuo legislativo específico para IA dificulta, mas não impede a punição.

“A lei brasileira ainda está em processo de adaptação, com o Projeto de Lei da Inteligência Artificial (PL 2338/2023) em tramitação no Senado. Contudo, o crime fim já tem punição. Se usaram sua voz para roubar dinheiro, é estelionato. Se usaram seu rosto em um vídeo difamatório, temos crimes contra a honra e danos morais severos”, explica Marcos André.

A dificuldade real não é a falta de crime no Código Penal, mas sim a identificação da autoria, já que os criminosos usam servidores estrangeiros e contas laranjas. Por isso, a defesa primária deve focar em dificultar o acesso aos seus dados biométricos.

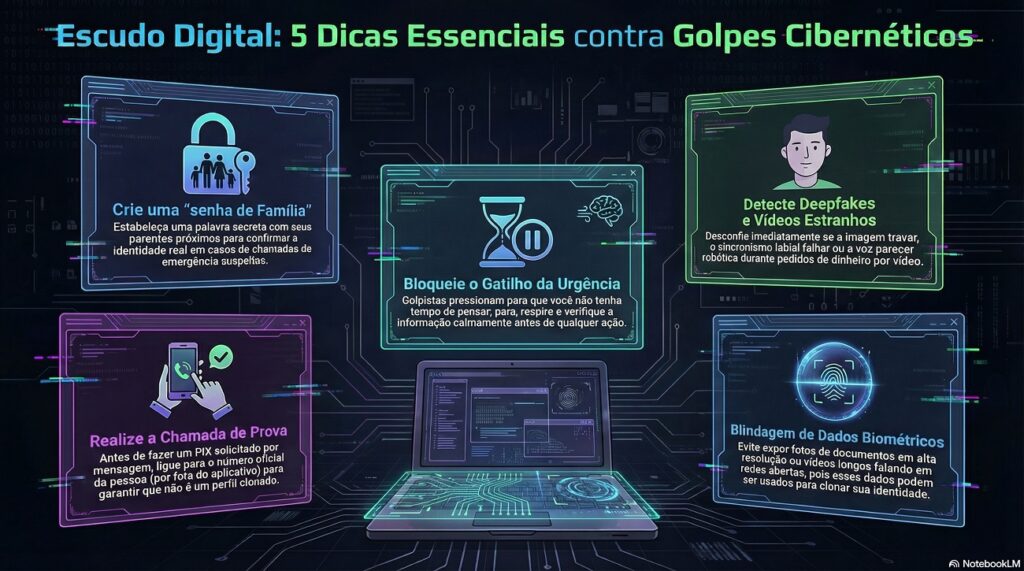

Para se blindar, o especialista recomenda atitudes drásticas, mas necessárias na era sintética:

- Privacidade máxima: Restrinja quem pode ver sua foto de perfil e seus Stories no WhatsApp e Instagram. Menos amostras públicas significam menos material para a IA treinar.

- Palavra de segurança: Combine uma senha secreta com sua família. Se a “sua mãe” mandar um áudio pedindo dinheiro, exija que ela responda com a palavra de segurança antes de qualquer transferência.

- Denuncie rapidamente: Se descobrir um vídeo falso seu circulando, preserve as provas (URLs e prints) e busque plataformas como a SaferNet Brasil para orientações de remoção e denúncia imediata.

No submundo dos crimes sintéticos, a velha máxima de “ver para crer” perdeu a validade. Na internet de hoje, desconfiar dos próprios olhos e ouvidos tornou-se a primeira e mais importante camada de proteção jurídica e financeira que você pode ter.