Com o boom crescente das IAs, e dados que apontam que 93% dos brasileiros conectados já utilizam alguns dos milhares de modelos disponíveis, é possível imaginar o quanto a tecnologia vêm ficando mais acessível, não é mesmo? Contudo, isso não significa que a ferramenta está livre de qualquer reclamação ou problema. Afinal, mesmo sendo algo feito pra ser “inteligente”, antes de tudo, ela é “artificial”. Ou seja, passível de cometer os mesmos erros de quem as criam.

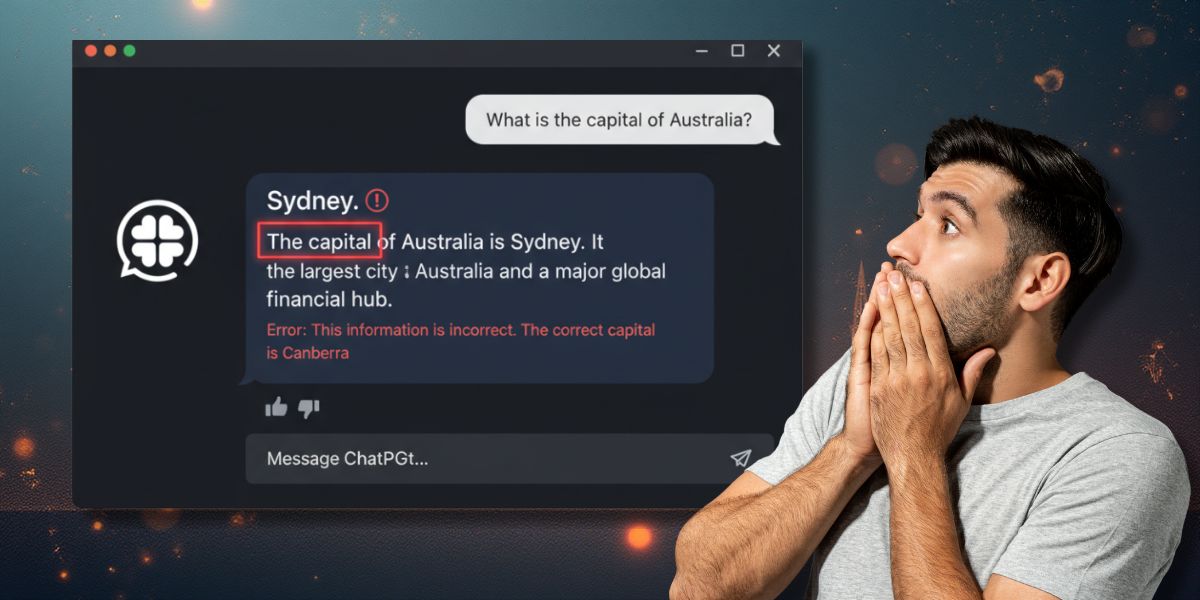

Para dar um exemplo prático, testei algo no ChatGPT na semana passada que fez ela “ficar vermelha de vergonha” (virtualmente, claro). E isto me fez perceber algo importante que ninguém fala: as máquinas que parecem infalíveis são, na verdade, extremamente constrangedoras quando erram.

E para contextualizar a importância de verificar informações quando se usa uma IA e, mais do que isso, entender onde ela acerta e onde erra, esse artigo conta com a assessoria da Ludy.Co – expert em branding e pioneira entre as agências que trabalham com marketing estruturado também para IAs – para mostrar os cuidados que todos devem ter quando resolvem usá-las, seja no trabalho, estudo ou lazer.

Uma resposta rápida (e completamente errada)

Há uma brincadeira onde uma pessoa desafia outra a diz que consegue responder qualquer cálculo matemática em segundos. Após isso, recebe um pedido complexo e aleatório e o responde na hora. O outro questiona se o cálculo realmente está certo e recebe a resposta: Eu disse que respondia rápido, não certo.

Pois essa analogia explica exatamente o que aconteceu comigo e a IA mais famosa do mundo, na semana passada. Perguntei ao Chat GPT: “Qual era o nome do presidente do Brasil em 1822?” Resposta imediata e confiante: “Dom Pedro II.”

Errado. Completamente errado. Era Dom Pedro I.

E a IA sabia isto há segundos atrás quando mencionei Independência.

Mas naquela pergunta específica? Alucinou. Inventou resposta.

E aqui está o constrangimento: Mesmo errada, a máquina não teve dúvida. Não disse “acho que…”. Não ofereceu alternativa. Apenas respondeu com convicção total sobre algo que estava completamente errado. Como se tivesse certeza absoluta.

É como alguém olhar nos seus olhos e afirmar com 100% de convicção algo que é falso. Embaraçoso.

Por que isto acontece?

O motivo desse e de outros erros diários das IAs se deve ao fato de que elas não “entendem” como você e eu entendemos. Elas não consultam um banco de dados mental onde as informações estão catalogadas. Elas fazem previsões. Adivinham qual é a próxima palavra mais provável baseada em padrões estatísticos de bilhões de textos que leram.

Pense assim: o ChatGPT é como alguém que leu absolutamente TUDO na história da humanidade (toda internet + livros), mas não consegue verificar nada enquanto fala. Apenas fala o que acha que é provável. E às vezes, quando o padrão está claro, ela acerta.

Quando o padrão é ambíguo? Ela inventa. E sim, isto é tão constrangedor quanto parece.

O problema não é IA cometer erros. É se mostrar confiante quando isso acontece

Se 0 Chat GPT dissesse “não tenho certeza, mas acho que…”, seria mais honesto. Mas não funciona assim. Isso porque ele foi otimizado para soar confiante e para parecer competente. Segundo uma pesquisa da Penn State University, os usuários preferem confiança a honestidade quando se trata de máquinas.

O resultado? Você confia em resposta que está tecnicamente alucinando (palavra técnica: “hallucination”). E passa a informação adiante e alguém escreve artigo baseado nisso.

E fake news nasce de IA sendo constrangidamente confiante sobre erros.

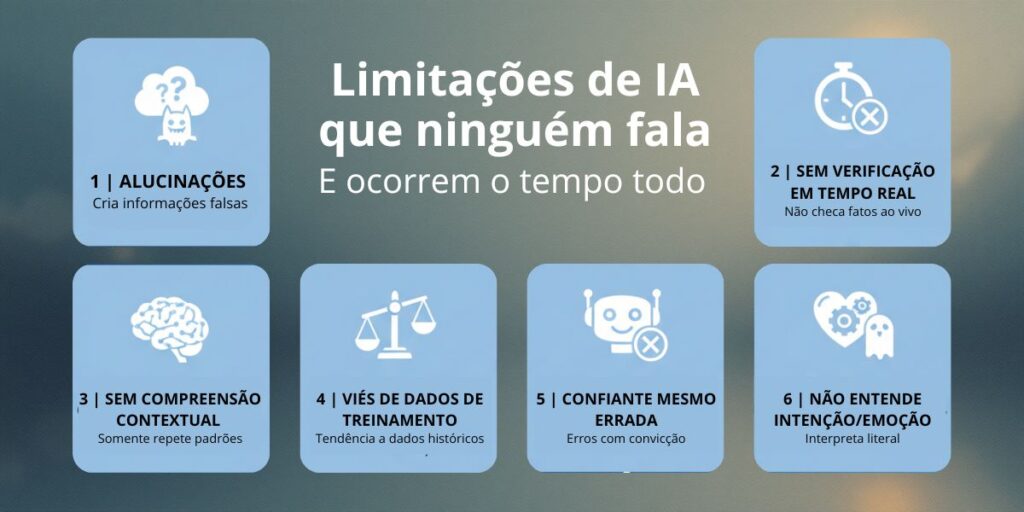

As limitações que ninguém menciona

Para resumir alguns pontos que poucos falar sobre os erros das IAs, confira o gráfico.

Mas aqui está a verdade incômoda:

Apesar de todas essas limitações ridículas, a maior parte das IAs são extremamente ÚTEIS. Ainda ajudam. e poupam tempo. Ainda resolvem problema. Porém, permanecem distante de serem infalíveis. Em uma comparação simples, podemos dizer que ela ainda está mais próxima de um GPS que de um piloto automático.

Afinal, mesmo ambos sendo importantes, o GPS te mostra o caminho mais rápido, economiza combustível, evita congestionamentos e até faz você descobrir rotas que nunca havia considerado. Mas o GPS não dirige o carro sozinho. Ou seja, você ainda precisa estar atento à estrada, perceber mudanças repentinas e reconhecer sinais que o app não consegue ler em tempo real.

E é aí que entra, obrigatoriamente, a necessidade de algumas verificações para não cair em uma cilada. No caso de empresas, isso ainda é mais sério e envolve – quando há pensamento estratégico e investimento planejado – a assessoria de uma agência de branding, marketing ou SEO.

O que aprender com constrangimento de ChatGPT:

Para quem usa IA para decisões importantes (negócio, saúde, finanças), a dica é uma só: nunca confie cegamente e sempre verifique e questione. Especialmente quando resposta soa muito confiante sobre coisa que você não tem certeza.

Isso porque máquinas costumam ser excelentes em padrão, mas ruins em verificação. Excelentes em gerar ideias, porém péssimas em garantir correção. Sendo assim, para extrair o melhor de uma IA, faça sempre o seguinte:

- Peça para que ela gere, por exemplo, de 3 a 5 ideias e, depois, você valida;

- No caso de dúvidas, tente refazer o pedido sem estar com o login ativo. Isso “limpa” seu histórico e possibilita que receba uma resposta menos tendenciosa;

- Caso seja um usuário frequente, atente-se de, tempos em tempos, avaliar a porcentagem de efetividade das respostas. Você pode, por exemplo, buscar por comandos diferentes para que alguns “vícios” causados pela utilização fiquem menos evidentes.

Por fim, anote esta dica que pode te fazer rir por horas ou ter o maior susto da sua vida quando se trata de IAs. Se você é um usuário ativo de redes sociais, possui uma empresa ou trabalha em qualquer setor com certa visibilidade, peça à IA um relatório sobre você. Porém, acrescente no pedido para que ela liste pontos desfavoráveis ou negativos e veja a mágica acontecer.

Por aqui, caso eu não fosse um profissional da área de marketing, e jornalista ficaria realmente preocupado. Afinal, nunca fui bom de bola nem mesmo entendo de programação. Por outro lado, não é impossível que o meu homônimo jogador do São Paulo não possa dedicar ao SEO, já que volta ao campos apenas em 2026. Em todo caso, vou me manter alerta e, recomendo: façam o mesmo!